Рассмотрим Распределение ХИ-квадрат. С помощью функции MS EXCEL ХИ2.РАСП() построим графики функции распределения и плотности вероятности, поясним применение этого распределения для целей математической статистики.

Распределение ХИ-квадрат (Х 2 , ХИ2, англ. Chi - squared distribution ) применяется в различных методах математической статистики:

- при построении ;

- при ;

- при (согласуются ли эмпирические данные с нашим предположением о теоретической функции распределения или нет, англ. Goodness-of-fit)

- при (используется для определения связи между двумя категориальными переменными, англ. Chi-square test of association).

Определение : Если x 1 , x 2 , …, x n независимые случайные величины, распределенные по N(0;1), то распределение случайной величины Y=x 1 2 + x 2 2 +…+ x n 2 имеет распределение Х 2 с n степенями свободы.

Распределение Х 2 зависит от одного параметра, который называется степенью свободы (df , degrees of freedom ). Например, при построении число степеней свободы равно df=n-1, где n – размер выборки .

Плотность распределения

Х 2

выражается формулой:

Графики функций

Распределение Х 2 имеет несимметричную форму, равно n, равна 2n.

В файле примера на листе График приведены графики плотности распределения вероятности и интегральной функции распределения .

Полезное свойство ХИ2-распределения

Пусть x 1 , x 2 , …, x n независимые случайные величины, распределенные по нормальному закону

с одинаковыми параметрами μ и σ, а X cр

является арифметическим средним

этих величин x.

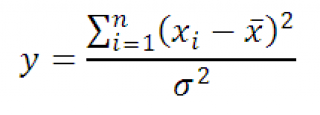

Тогда случайная величина y

равная

Имеет Х 2 -распределение с n-1 степенью свободы. Используя определение вышеуказанное выражение можно переписать следующим образом:

Следовательно, выборочное распределение статистики y, при выборке из нормального распределения , имеет Х 2 -распределение с n-1 степенью свободы.

Это свойство нам потребуется при . Т.к. дисперсия может быть только положительным числом, а Х 2 -распределение используется для его оценки, то y д.б. >0, как и указано в определении.

ХИ2-распределение в MS EXCEL

В MS EXCEL, начиная с версии 2010, для Х 2 -распределения имеется специальная функция ХИ2.РАСП() , английское название – CHISQ.DIST(), которая позволяет вычислить плотность вероятности (см. формулу выше) и (вероятность, что случайная величина Х, имеющая ХИ2 -распределение , примет значение меньше или равное х, P{X <= x}).

Примечание : Т.к. ХИ2-распределение является частным случаем , то формула =ГАММА.РАСП(x;n/2;2;ИСТИНА) для целого положительного n возвращает тот же результат, что и формула =ХИ2.РАСП(x;n; ИСТИНА) или =1-ХИ2.РАСП.ПХ(x;n) . А формула =ГАММА.РАСП(x;n/2;2;ЛОЖЬ) возвращает тот же результат, что и формула =ХИ2.РАСП(x;n; ЛОЖЬ) , т.е. плотность вероятности ХИ2-распределения.

Функция ХИ2.РАСП.ПХ()

возвращает функцию распределения

, точнее - правостороннюю вероятность, т.е. P{X > x}. Очевидно, что справедливо равенство

=ХИ2.РАСП.ПХ(x;n)+ ХИ2.РАСП(x;n;ИСТИНА)=1

т.к. первое слагаемое вычисляет вероятность P{X > x}, а второе P{X <= x}.

До MS EXCEL 2010 в EXCEL была только функция ХИ2РАСП() , которая позволяет вычислить правостороннюю вероятность, т.е. P{X > x}. Возможности новых функций MS EXCEL 2010 ХИ2.РАСП() и ХИ2.РАСП.ПХ() перекрывают возможности этой функции. Функция ХИ2РАСП() оставлена в MS EXCEL 2010 для совместимости.

ХИ2.РАСП() является единственной функцией, которая возвращает плотность вероятности ХИ2-распределения (третий аргумент должен быть равным ЛОЖЬ). Остальные функции возвращают интегральную функцию распределения , т.е. вероятность того, что случайная величина примет значение из указанного диапазона: P{X <= x}.

Вышеуказанные функции MS EXCEL приведены в .

Примеры

Найдем вероятность, что случайная величина Х примет значение меньше или равное заданного x : P{X <= x}. Это можно сделать несколькими функциями:

ХИ2.РАСП(x; n; ИСТИНА)

=1-ХИ2.РАСП.ПХ(x; n)

=1-ХИ2РАСП(x; n)

Функция ХИ2.РАСП.ПХ() возвращает вероятность P{X > x}, так называемую правостороннюю вероятность, поэтому, чтобы найти P{X <= x}, необходимо вычесть ее результат от 1.

Найдем вероятность, что случайная величина Х примет значение больше заданного x : P{X > x}. Это можно сделать несколькими функциями:

1-ХИ2.РАСП(x; n; ИСТИНА)

=ХИ2.РАСП.ПХ(x; n)

=ХИ2РАСП(x; n)

Обратная функция ХИ2-распределения

Обратная функция используется для вычисления альфа - , т.е. для вычисления значений x при заданной вероятности альфа , причем х должен удовлетворять выражению P{X <= x}=альфа .

Функция ХИ2.ОБР() используется для вычисления доверительных интервалов дисперсии нормального распределения .

Функция ХИ2.ОБР.ПХ() используется для вычисления , т.е. если в качестве аргумента функции указан уровень значимости, например 0,05, то функция вернет такое значение случайной величины х, для которого P{X>x}=0,05. В качестве сравнения: функция ХИ2.ОБР() вернет такое значение случайной величины х, для которого P{X<=x}=0,05.

В MS EXCEL 2007 и ранее вместо ХИ2.ОБР.ПХ() использовалась функция ХИ2ОБР() .

Вышеуказанные функции можно взаимозаменять, т.к. следующие формулы возвращают один и тот же результат:

=ХИ.ОБР(альфа;n)

=ХИ2.ОБР.ПХ(1-альфа;n)

=ХИ2ОБР(1- альфа;n)

Некоторые примеры расчетов приведены в файле примера на листе Функции .

Функции MS EXCEL, использующие ХИ2-распределение

Ниже приведено соответствие русских и английских названий функций:

ХИ2.РАСП.ПХ()

- англ. название CHISQ.DIST.RT, т.е. CHI-SQuared DISTribution Right Tail, the right-tailed Chi-square(d) distribution

ХИ2.ОБР()

- англ. название CHISQ.INV, т.е. CHI-SQuared distribution INVerse

ХИ2.ПХ.ОБР()

- англ. название CHISQ.INV.RT, т.е. CHI-SQuared distribution INVerse Right Tail

ХИ2РАСП()

- англ. название CHIDIST, функция эквивалентна CHISQ.DIST.RT

ХИ2ОБР()

- англ. название CHIINV, т.е. CHI-SQuared distribution INVerse

Оценка параметров распределения

Т.к. обычно ХИ2-распределение используется для целей математической статистики (вычисление доверительных интервалов, проверки гипотез и др.), и практически никогда для построения моделей реальных величин, то для этого распределения обсуждение оценки параметров распределения здесь не производится.

Приближение ХИ2-распределения нормальным распределением

При числе степеней свободы n>30 распределение Х 2

хорошо аппроксимируется нормальным распределением

со средним значением

μ=n и дисперсией σ

=2*n (см. файл примера лист Приближение

).

Критерий \(\chi^2\) ("хи-квадрат", также "критерий согласия Пирсона") имеет чрезвычайно широкое применение в статистике. В общем виде можно сказать, что он используется для проверки нулевой гипотезы о подчинении наблюдаемой случайной величины определенному теоретическому закону распределения (подробнее см., например, ). Конкретная формулировка проверяемой гипотезы от случая к случаю будет варьировать.

В этом сообщении я опишу принцип работы критерия \(\chi^2\) на (гипотетическом) примере из иммунологии . Представим, что мы выполнили эксперимент по установлению эффективности подавления развития микробного заболевания при введении в организм соответствующих антител . Всего в эксперименте было задействовано 111 мышей, которых мы разделили на две группы, включающие 57 и 54 животных соответственно. Первой группе мышей сделали инъекции патогенных бактерий с последующим введением сыворотки крови, содержащей антитела против этих бактерий. Животные из второй группы служили контролем – им сделали только бактериальные инъекции. После некоторого времени инкубации оказалось, что 38 мышей погибли, а 73 выжили. Из погибших 13 принадлежали первой группе, а 25 – ко второй (контрольной). Проверяемую в этом эксперименте нулевую гипотезу можно сформулировать так: введение сыворотки с антителами не оказывает никакого влияния на выживаемость мышей. Иными словами, мы утверждаем, что наблюдаемые различия в выживаемости мышей (77.2% в первой группе против 53.7% во второй группе) совершенно случайны и не связаны с действием антител.

Полученные в эксперименте данные можно представить в виде таблицы:

Всего |

|||

Бактерии + сыворотка |

|||

Только бактерии |

|||

Всего |

Таблицы, подобные приведенной, называют таблицами сопряженности . В рассматриваемом примере таблица имеет размерность 2х2: есть два класса объектов («Бактерии + сыворотка» и «Только бактерии»), которые исследуются по двум признакам ("Погибло" и "Выжило"). Это простейший случай таблицы сопряженности: безусловно, и количество исследуемых классов, и количество признаков может быть бóльшим.

Для проверки сформулированной выше нулевой гипотезы нам необходимо знать, какова была бы ситуация, если бы антитела действительно не оказывали никакого действия на выживаемость мышей. Другими словами, нужно рассчитать ожидаемые частоты для соответствующих ячеек таблицы сопряженности. Как это сделать? В эксперименте всего погибло 38 мышей, что составляет 34.2% от общего числа задействованных животных. Если введение антител не влияет на выживаемость мышей, в обеих экспериментальных группах должен наблюдаться одинаковый процент смертности, а именно 34.2%. Рассчитав, сколько составляет 34.2% от 57 и 54, получим 19.5 и 18.5. Это и есть ожидаемые величины смертности в наших экспериментальных группах. Аналогичным образом рассчитываются и ожидаемые величины выживаемости: поскольку всего выжили 73 мыши, или 65.8% от общего их числа, то ожидаемые частоты выживаемости составят 37.5 и 35.5. Составим новую таблицу сопряженности, теперь уже с ожидаемыми частотами:

Погибшие |

Выжившие |

Всего |

|

Бактерии + сыворотка |

|||

Только бактерии |

|||

Всего |

Как видим, ожидаемые частоты довольно сильно отличаются от наблюдаемых, т.е. введение антител, похоже, все-таки оказывает влияние на выживаемость мышей, зараженных патогенным микроорганизмом. Это впечатление мы можем выразить количественно при помощи критерия согласия Пирсона \(\chi^2\):

\[\chi^2 = \sum_{}\frac{(f_o - f_e)^2}{f_e},\]

где \(f_o\) и \(f_e\) - наблюдаемые и ожидаемые частоты соответственно. Суммирование производится по всем ячейкам таблицы. Так, для рассматриваемого примера имеем

\[\chi^2 = (13 – 19.5)^2/19.5 + (44 – 37.5)^2/37.5 + (25 – 18.5)^2/18.5 + (29 – 35.5)^2/35.5 = \]

Достаточно ли велико полученное значение \(\chi^2\), чтобы отклонить нулевую гипотезу? Для ответа на этот вопрос необходимо найти соответствующее критическое значение критерия. Число степеней свободы для \(\chi^2\) рассчитывается как \(df = (R - 1)(C - 1)\), где \(R\) и \(C\) - количество строк и столбцов в таблице сопряженности. В нашем случае \(df = (2 -1)(2 - 1) = 1\). Зная число степеней свободы, мы теперь легко можем узнать критическое значение \(\chi^2\) при помощи стандартной R-функции qchisq() :

Таким образом, при одной степени свободы только в 5% случаев величина критерия \(\chi^2\) превышает 3.841. Полученное нами значение 6.79 значительно превышает это критического значение, что дает нам право отвергнуть нулевую гипотезу об отсутствии связи между введением антител и выживаемостью зараженных мышей. Отвергая эту гипотезу, мы рискуем ошибиться с вероятностью менее 5%.

Следует отметить, что приведенная выше формула для критерия \(\chi^2\) дает несколько завышенные значения при работе с таблицами сопряженности размером 2х2. Причина заключается в том, что распределение самого критерия \(\chi^2\) является непрерывным, тогда как частоты бинарных признаков ("погибло" / "выжило") по определению дискретны. В связи с этим при расчете критерия принято вводить т.н. поправку на непрерывность , или поправку Йетса :

\[\chi^2_Y = \sum_{}\frac{(|f_o - f_e| - 0.5)^2}{f_e}.\]

Pearson"s Chi-squared test with Yates" continuity correction data : mice X-squared = 5.7923 , df = 1 , p-value = 0.0161

Как видим, R автоматически применяет поправку Йетса на непрерывность (Pearson"s Chi-squared test with Yates" continuity correction ). Рассчитанное программой значение \(\chi^2\) составило 5.79213. Мы можем отклонить нулевую гипотезу об отсутствии эффекта антител, рискуя ошибиться с вероятностью чуть более 1% (p-value = 0.0161 ).

Министерство образования и науки Российской Федерации

Федеральное агентство по образованию города Иркутска

Байкальский государственный университет экономики и права

Кафедра Информатики и Кибернетики

Распределение "хи-квадрат" и его применение

Колмыкова Анна Андреевна

студентка 2 курса

группы ИС-09-1

Для обработки полученных данных используем критерий хи-квадрат.

Для этого построим таблицу распределения эмпирических частот, т.е. тех частот, которые мы наблюдаем:

Теоретически, мы ожидаем, что частоты распределятся равновероятно, т.е. частота распределится пропорционально между мальчиками и девочками. Построим таблицу теоретических частот. Для этого умножим сумму по строке на сумму по столбцу и разделим получившееся число на общую сумму (s).

Итоговая таблица для вычислений будет выглядеть так:

χ2 = ∑(Э - Т)² / Т

n = (R - 1), где R – количество строк в таблице.

В нашем случае хи-квадрат = 4,21; n = 2.

По таблице критических значений критерия находим: при n = 2 и уровне ошибки 0,05 критическое значение χ2 = 5,99.

Полученное значение меньше критического, а значит принимается нулевая гипотеза.

Вывод: учителя не придают значение полу ребенка при написании ему характеристики.

Приложение

Критические точки распределения χ2

Таблица 1

Заключение

Студенты почти всех специальностей изучают в конце курса высшей математики раздел "теория вероятностей и математическая статистика", реально они знакомятся лишь с некоторыми основными понятиями и результатами, которых явно не достаточно для практической работы. С некоторыми математическими методами исследования студенты встречаются в специальных курсах (например, таких, как "Прогнозирование и технико-экономическое планирование", "Технико-экономический анализ", "Контроль качества продукции", "Маркетинг", "Контроллинг", "Математические методы прогнозирования", "Статистика" и др. – в случае студентов экономических специальностей), однако изложение в большинстве случаев носит весьма сокращенный и рецептурный характер. В результате знаний у специалистов по прикладной статистике недостаточно.

Поэтому большое значение имеет курс "Прикладная статистика" в технических вузах, а в экономических вузах – курса "Эконометрика", поскольку эконометрика – это, как известно, статистический анализ конкретных экономических данных.

Теория вероятности и математическая статистика дают фундаментальные знания для прикладной статистики и эконометрики.

Они необходимы специалистам для практической работы.

Я рассмотрела непрерывную вероятностную модель и постаралась на примерах показать ее используемость.

Список используемой литературы

1. Орлов А.И. Прикладная статистика. М.: Издательство "Экзамен", 2004.

2. Гмурман В.Е. Теория вероятностей и математическая статистика. М.: Высшая школа, 1999. – 479с.

3. Айвозян С.А. Теория вероятностей и прикладная статистика, т.1. М.: Юнити, 2001. – 656с.

4. Хамитов Г.П., Ведерникова Т.И. Вероятности и статистика. Иркутск: БГУЭП, 2006 – 272с.

5. Ежова Л.Н. Эконометрика. Иркутск: БГУЭП, 2002. – 314с.

6. Мостеллер Ф. Пятьдесят занимательных вероятностных задач с решениями. М. : Наука, 1975. – 111с.

7. Мостеллер Ф. Вероятность. М. : Мир, 1969. – 428с.

8. Яглом А.М. Вероятность и информация. М. : Наука, 1973. – 511с.

9. Чистяков В.П. Курс теории вероятностей. М.: Наука, 1982. – 256с.

10. Кремер Н.Ш. Теория вероятностей и математическая статистика. М.: ЮНИТИ, 2000. – 543с.

11. Математическая энциклопедия, т.1. М.: Советская энциклопедия, 1976. – 655с.

12. http://psystat.at.ua/ - Статистика в психологии и педагогике. Статья Критерий Хи-квадрат.

До конца XIX века нормальное распределение считалась всеобщим законом вариации данных. Однако К. Пирсон заметил, что эмпирические частоты могут сильно отличаться от нормального распределения. Встал вопрос, как это доказать. Требовалось не только графическое сопоставление, которое имеет субъективный характер, но и строгое количественное обоснование.

Так был изобретен критерий χ 2 (хи квадрат), который проверяет значимость расхождения эмпирических (наблюдаемых) и теоретических (ожидаемых) частот. Это произошло в далеком 1900 году, однако критерий и сегодня на ходу. Более того, его приспособили для решения широкого круга задач. Прежде всего, это анализ категориальных данных, т.е. таких, которые выражаются не количеством, а принадлежностью к какой-то категории. Например, класс автомобиля, пол участника эксперимента, вид растения и т.д. К таким данным нельзя применять математические операции вроде сложения и умножения, для них можно только подсчитать частоты.

Наблюдаемые частоты обозначим О (Observed) , ожидаемые – E (Expected) . В качестве примера возьмем результат 60-кратного бросания игральной кости. Если она симметрична и однородна, вероятность выпадения любой стороны равна 1/6 и, следовательно, ожидаемое количество выпадения каждой из сторон равна 10 (1/6∙60). Наблюдаемые и ожидаемые частоты запишем в таблицу и нарисуем гистограмму.

Нулевая гипотеза заключается в том, что частоты согласованы, то есть фактические данные не противоречат ожидаемым. Альтернативная гипотеза – отклонения в частотах выходят за рамки случайных колебаний, расхождения статистически значимы. Чтобы сделать строгий вывод, нам потребуется.

- Обобщающая мера расхождения между наблюдаемыми и ожидаемыми частотами.

- Распределение этой меры при справедливости гипотезы о том, что различий нет.

Начнем с расстояния между частотами. Если взять просто разницу О — E , то такая мера будет зависеть от масштаба данных (частот). Например, 20 — 5 =15 и 1020 – 1005 = 15. В обоих случаях разница составляет 15. Но в первом случае ожидаемые частоты в 3 раза меньше наблюдаемых, а во втором случае – лишь на 1,5%. Нужна относительная мера, не зависящая от масштаба.

Обратим внимание на следующие факты. В общем случае количество категорий, по которым измеряются частоты, может быть гораздо больше, поэтому вероятность того, что отдельно взятое наблюдение попадет в ту или иную категорию, довольно мала. Раз так, то, распределение такой случайной величины будет подчинятся закону редких событий, известному под названием закон Пуассона . В законе Пуассона, как известно, значение математического ожидания и дисперсии совпадают (параметр λ ). Значит, ожидаемая частота для некоторой категории номинальной переменной E i будет являться одновременное и ее дисперсией. Далее, закон Пуассона при большом количестве наблюдений стремится к нормальному. Соединяя эти два факта, получаем, что, если гипотеза о согласии наблюдаемых и ожидаемых частот верна, то, при большом количестве наблюдений , выражение

Важно помнить, что нормальность будет проявляться только при достаточно больших частотах. В статистике принято считать, что общее количество наблюдений (сумма частот) должна быть не менее 50 и ожидаемая частота в каждой градации должна быть не менее 5. Только в этом случае величина, показанная выше, имеет стандартное нормальное распределение. Предположим, что это условие выполнено.

У стандартного нормального распределения почти все значение находятся в пределах ±3 (правило трех сигм). Таким образом, мы получили относительную разность в частотах для одной градации. Нам нужна обобщающая мера. Просто сложить все отклонения нельзя – получим 0 (догадайтесь почему). Пирсон предложил сложить квадраты этих отклонений.

![]()

Это и есть знамений критерий Хи-квадрат Пирсона . Если частоты действительно соответствуют ожидаемым, то значение критерия будет относительно не большим (т.к. большинство отклонений находится около нуля). Но если критерий оказывается большим, то это свидетельствует в пользу существенных различий между частотами.

«Большим» критерий Пирсона становится тогда, когда появление такого или еще большего значения становится маловероятным. И чтобы рассчитать такую вероятность, необходимо знать распределение критерия при многократном повторении эксперимента, когда гипотеза о согласии частот верна.

Как нетрудно заметить, величина хи-квадрат также зависит от количества слагаемых. Чем их больше, тем большее значение должно быть у критерия, ведь каждое слагаемое внесет свой вклад в общую сумму. Следовательно, для каждого количества независимых слагаемых, будет собственное распределение. Получается, что χ 2 – это целое семейство распределений.

И здесь мы подошли к одному щекотливому моменту. Что такое число независимых слагаемых? Вроде как любое слагаемое (т.е. отклонение) независимо. К. Пирсон тоже так думал, но оказался неправ. На самом деле число независимых слагаемых будет на один меньше, чем количество градаций номинальной переменной n . Почему? Потому что, если мы имеем выборку, по которой уже посчитана сумма частот, то одну из частот всегда можно определить, как разность общего количества и суммой всех остальных. Отсюда и вариация будет несколько меньше. Данный факт Рональд Фишер заметил лет через 20 после разработки Пирсоном своего критерия. Даже таблицы пришлось переделывать.

По этому поводу Фишер ввел в статистику новое понятие – степень свободы (degrees of freedom), которое и представляет собой количество независимых слагаемых в сумме. Понятие степеней свободы имеет математическое объяснение и проявляется только в распределениях, связанных с нормальным (Стьюдента, Фишера-Снедекора и сам хи-квадрат).

Чтобы лучше уловить смысл степеней свободы, обратимся к физическому аналогу. Представим точку, свободно движущуюся в пространстве. Она имеет 3 степени свободы, т.к. может перемещаться в любом направлении трехмерного пространства. Если точка движется по какой-либо поверхности, то у нее уже две степени свободы (вперед-назад, вправо-влево), хотя и продолжает находиться в трехмерном пространстве. Точка, перемещающаяся по пружине, снова находится в трехмерном пространстве, но имеет лишь одну степень свободы, т.к. может двигаться либо вперед, либо назад. Как видно, пространство, где находится объект, не всегда соответствует реальной свободе перемещения.

Примерно также распределение статистического критерия может зависеть от меньшего количества элементов, чем нужно слагаемых для его расчета. В общем случае количество степеней свободы меньше наблюдений на число имеющихся зависимостей.

Таким образом, распределение хи квадрат (χ 2 ) – это семейство распределений, каждое из которых зависит от параметра степеней свободы. А формальное определение критерия хи-квадрат следующее. Распределение χ 2 (хи-квадрат) с k степенями свободы - это распределение суммы квадратов k независимых стандартных нормальных случайных величин.

Далее можно было бы перейти к самой формуле, по которой вычисляется функция распределения хи-квадрат, но, к счастью, все давно подсчитано за нас. Чтобы получить интересующую вероятность, можно воспользоваться либо соответствующей статистической таблицей, либо готовой функцией в Excel.

Интересно посмотреть, как меняется форма распределения хи-квадрат в зависимости от количества степеней свободы.

С увеличением степеней свободы распределение хи-квадрат стремится к нормальному. Это объясняется действием центральной предельной теоремы, согласно которой сумма большого количества независимых случайных величин имеет нормальное распределение. Про квадраты там ничего не сказано)).

Проверка гипотезы по критерию хи квадрат Пирсона

Вот мы и подошли к проверке гипотез по методу хи-квадрат. В целом техника остается . Выдвигается нулевая гипотеза о том, что наблюдаемые частоты соответствуют ожидаемым (т.е. между ними нет разницы, т.к. они взяты из той же генеральной совокупности). Если этот так, то разброс будет относительно небольшим, в пределах случайных колебаний. Меру разброса определяют по критерию хи-квадрат. Далее либо сам критерий сравнивают с критическим значением (для соответствующего уровня значимости и степеней свободы), либо, что более правильно, рассчитывают наблюдаемый p-value, т.е. вероятность получить такое или еще больше значение критерия при справедливости нулевой гипотезы.

Т.к. нас интересует согласие частот, то отклонение гипотезы произойдет, когда критерий окажется больше критического уровня. Т.е. критерий является односторонним. Однако иногда (иногда) требуется проверить левостороннюю гипотезу. Например, когда эмпирические данные уж оооочень сильно похожи на теоретические. Тогда критерий может попасть в маловероятную область, но уже слева. Дело в том, что в естественных условиях, маловероятно получить частоты, практически совпадающие с теоретическими. Всегда есть некоторая случайность, которая дает погрешность. А вот если такой погрешности нет, то, возможно, данные были сфальсифицированы. Но все же обычно проверяют правостороннюю гипотезу.

Вернемся к задаче с игральной костью. Рассчитаем по имеющимся данным значение критерия хи-квадрат.

Теперь найдем критическое значение при 5-ти степенях свободы (k ) и уровне значимости 0,05 (α ) по таблице критических значений распределения хи квадрат.

То есть квантиль 0,05 хи квадрат распределения (правый хвост) с 5-ю степенями свободы χ 2 0,05; 5 = 11,1.

Сравним фактическое и табличное значение. 3,4 (χ 2 ) < 11,1 (χ 2 0,05; 5 ). Расчетный критерий оказался меньшим, значит гипотеза о равенстве (согласии) частот не отклоняется. На рисунке ситуация выглядит вот так.

Если бы расчетное значение попало в критическую область, то нулевая гипотеза была бы отклонена.

Более правильным будет рассчитать еще и p-value. Для этого нужно в таблице найти ближайшее значение для заданного количества степеней свободы и посмотреть соответствующий ему уровень значимости. Но это прошлый век. Воспользуемся ЭВМ, в частности MS Excel. В эксель есть несколько функций, связанных с хи-квадрат.

Ниже их краткое описание.

ХИ2.ОБР – критическое значение критерия при заданной вероятности слева (как в статистических таблицах)

ХИ2.ОБР.ПХ – критическое значение критерия при заданной вероятности справа. Функция по сути дублирует предыдущую. Но здесь можно сразу указывать уровень α , а не вычитать его из 1. Это более удобно, т.к. в большинстве случаев нужен именно правый хвост распределения.

ХИ2.РАСП – p-value слева (можно рассчитать плотность).

ХИ2.РАСП.ПХ – p-value справа.

ХИ2.ТЕСТ – по двум диапазонам частот сразу проводит хи-квадрат тест. Количество степеней свободы берется на одну меньше, чем количество частот в столбце (так и должно быть), возвращая значение p-value.

Давайте пока рассчитаем для нашего эксперимента критическое (табличное) значение для 5-ти степеней свободы и альфа 0,05. Формула Excel будет выглядеть так:

ХИ2.ОБР(0,95;5)

ХИ2.ОБР.ПХ(0,05;5)

Результат будет одинаковым – 11,0705. Именно это значение мы видим в таблице (округленное до 1 знака после запятой).

Рассчитаем, наконец, p-value для 5-ти степеней свободы критерия χ 2 = 3,4. Нужна вероятность справа, поэтому берем функцию с добавкой ПХ (правый хвост)

ХИ2.РАСП.ПХ(3,4;5) = 0,63857

Значит, при 5-ти степенях свободы вероятность получить значение критерия χ 2 = 3,4 и больше равна почти 64%. Естественно, гипотеза не отклоняется (p-value больше 5%), частоты очень хорошо согласуются.

А теперь проверим гипотезу о согласии частот с помощью теста хи квадрат и функции Excel ХИ2.ТЕСТ.

Никаких таблиц, никаких громоздких расчетов. Указав в качестве аргументов функции столбцы с наблюдаемыми и ожидаемыми частотами, сразу получаем p-value. Красота.

Представим теперь, что вы играете в кости с подозрительным типом. Распределение очков от 1 до 5 остается прежним, но он выкидывает 26 шестерок (количество всех бросков становится 78).

p-value в этом случае оказывается 0,003, что гораздо меньше чем, 0,05. Есть серьезные основания сомневаться в правильности игральной кости. Вот, как выглядит эта вероятность на диаграмме распределения хи-квадрат.

Сам критерий хи-квадрат здесь получается 17,8, что, естественно, больше табличного (11,1).

Надеюсь, мне удалось объяснить, что такое критерий согласия χ 2 (хи-квадрат) Пирсона и как с его помощью проверяются статистические гипотезы.

Напоследок еще раз о важном условии! Критерий хи-квадрат исправно работает только в случае, когда количество всех частот превышает 50, а минимальное ожидаемое значение для каждой градации не меньше 5. Если в какой-либо категории ожидаемая частота менее 5, но при этом сумма всех частот превышает 50, то такую категорию объединяют с ближайшей, чтобы их общая частота превысила 5. Если это сделать невозможно, или сумма частот меньше 50, то следует использовать более точные методы проверки гипотез. О них поговорим в другой раз.

Ниже находится видео ролик о том, как в Excel проверить гипотезу с помощью критерия хи-квадрат.

Пусть U 1 , U 2 , ..,U k - независимые стандартные нормальные величины. Распределение случайной величины K = U 1 2 +U 2 2 + .. + U k 2 называется распределением «хи-квадрат» с k степенями свободы (пишут K~χ 2 (k)). Это унимодальное распределение с положительной асимметрией и следующими характеристиками: мода M=k-2 математическое ожидание m=k дисперсия D=2k (рис.). При достаточно большом значении параметра k распределение χ 2 (k) имеет приближенно нормальное распределение с параметрами

При решении задач математической статистики используются критические точки χ 2 (k) зависящие от заданной вероятности α и числа степеней свободы k

(приложение 2). Критическая точка Χ 2 кр =Χ 2 (k; α) является границей области, правее которой лежит 100- α % площади под кривой плотности распределения. Вероятность того, что значение случайной величины K~χ 2 (k)при испытаниях попадет правее точки χ 2 (k) не превышает α P(K≥χ 2 kp)≤ α). Например, для случайной величины K~χ 2 (20) зададим вероятность α=0.05. По таблице критических точек распределения «хи-квадрат» (таблицы) находим χ 2 kp = χ 2 (20;0.05)=31.4. Значит, вероятность этой случайной величине K

принять значение, большее 31.4, меньше 0.05 (рис.).

Рис. График плотности распределения χ 2 (k)при различных значениях числа степеней свободы k

Критические точки χ 2 (k) используются в следующих калькуляторах:

- Проверка наличия мультиколлинеарности (о мультиколлинеарности).

Поэтому для проверки направления связи выбирается корреляционный анализ, в частности проверка гипотезы при помощи коэффициента корреляции Пирсона с дальнейшей проверкой на достоверность при помощи t-критерия.

Для любого значения уровня значимости α Χ 2 можно найти с помощью функции MS Excel : =ХИ2ОБР(α;степеней свободы)

| n-1 | .995 | .990 | .975 | .950 | .900 | .750 | .500 | .250 | .100 | .050 | .025 | .010 | .005 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0.00004 | 0.00016 | 0.00098 | 0.00393 | 0.01579 | 0.10153 | 0.45494 | 1.32330 | 2.70554 | 3.84146 | 5.02389 | 6.63490 | 7.87944 |

| 2 | 0.01003 | 0.02010 | 0.05064 | 0.10259 | 0.21072 | 0.57536 | 1.38629 | 2.77259 | 4.60517 | 5.99146 | 7.37776 | 9.21034 | 10.59663 |

| 3 | 0.07172 | 0.11483 | 0.21580 | 0.35185 | 0.58437 | 1.21253 | 2.36597 | 4.10834 | 6.25139 | 7.81473 | 9.34840 | 11.34487 | 12.83816 |

| 4 | 0.20699 | 0.29711 | 0.48442 | 0.71072 | 1.06362 | 1.92256 | 3.35669 | 5.38527 | 7.77944 | 9.48773 | 11.14329 | 13.27670 | 14.86026 |

| 5 | 0.41174 | 0.55430 | 0.83121 | 1.14548 | 1.61031 | 2.67460 | 4.35146 | 6.62568 | 9.23636 | 11.07050 | 12.83250 | 15.08627 | 16.74960 |

| 6 | 0.67573 | 0.87209 | 1.23734 | 1.63538 | 2.20413 | 3.45460 | 5.34812 | 7.84080 | 10.64464 | 12.59159 | 14.44938 | 16.81189 | 18.54758 |

| 7 | 0.98926 | 1.23904 | 1.68987 | 2.16735 | 2.83311 | 4.25485 | 6.34581 | 9.03715 | 12.01704 | 14.06714 | 16.01276 | 18.47531 | 20.27774 |

| 8 | 1.34441 | 1.64650 | 2.17973 | 2.73264 | 3.48954 | 5.07064 | 7.34412 | 10.21885 | 13.36157 | 15.50731 | 17.53455 | 20.09024 | 21.95495 |

| 9 | 1.73493 | 2.08790 | 2.70039 | 3.32511 | 4.16816 | 5.89883 | 8.34283 | 11.38875 | 14.68366 | 16.91898 | 19.02277 | 21.66599 | 23.58935 |

| 10 | 2.15586 | 2.55821 | 3.24697 | 3.94030 | 4.86518 | 6.73720 | 9.34182 | 12.54886 | 15.98718 | 18.30704 | 20.48318 | 23.20925 | 25.18818 |

| 11 | 2.60322 | 3.05348 | 3.81575 | 4.57481 | 5.57778 | 7.58414 | 10.34100 | 13.70069 | 17.27501 | 19.67514 | 21.92005 | 24.72497 | 26.75685 |

| 12 | 3.07382 | 3.57057 | 4.40379 | 5.22603 | 6.30380 | 8.43842 | 11.34032 | 14.84540 | 18.54935 | 21.02607 | 23.33666 | 26.21697 | 28.29952 |

| 13 | 3.56503 | 4.10692 | 5.00875 | 5.89186 | 7.04150 | 9.29907 | 12.33976 | 15.98391 | 19.81193 | 22.36203 | 24.73560 | 27.68825 | 29.81947 |

| 14 | 4.07467 | 4.66043 | 5.62873 | 6.57063 | 7.78953 | 10.16531 | 13.33927 | 17.11693 | 21.06414 | 23.68479 | 26.11895 | 29.14124 | 31.31935 |

| 15 | 4.60092 | 5.22935 | 6.26214 | 7.26094 | 8.54676 | 11.03654 | 14.33886 | 18.24509 | 22.30713 | 24.99579 | 27.48839 | 30.57791 | 32.80132 |

| 16 | 5.14221 | 5.81221 | 6.90766 | 7.96165 | 9.31224 | 11.91222 | 15.33850 | 19.36886 | 23.54183 | 26.29623 | 28.84535 | 31.99993 | 34.26719 |

| 17 | 5.69722 | 6.40776 | 7.56419 | 8.67176 | 10.08519 | 12.79193 | 16.33818 | 20.48868 | 24.76904 | 27.58711 | 30.19101 | 33.40866 | 35.71847 |

| 18 | 6.26480 | 7.01491 | 8.23075 | 9.39046 | 10.86494 | 13.67529 | 17.33790 | 21.60489 | 25.98942 | 28.86930 | 31.52638 | 34.80531 | 37.15645 |

| 19 | 6.84397 | 7.63273 | 8.90652 | 10.11701 | 11.65091 | 14.56200 | 18.33765 | 22.71781 | 27.20357 | 30.14353 | 32.85233 | 36.19087 | 38.58226 |

| 20 | 7.43384 | 8.26040 | 9.59078 | 10.85081 | 12.44261 | 15.45177 | 19.33743 | 23.82769 | 28.41198 | 31.41043 | 34.16961 | 37.56623 | 39.99685 |

| 21 | 8.03365 | 8.89720 | 10.28290 | 11.59131 | 13.23960 | 16.34438 | 20.33723 | 24.93478 | 29.61509 | 32.67057 | 35.47888 | 38.93217 | 41.40106 |

| 22 | 8.64272 | 9.54249 | 10.98232 | 12.33801 | 14.04149 | 17.23962 | 21.33704 | 26.03927 | 30.81328 | 33.92444 | 36.78071 | 40.28936 | 42.79565 |

| 23 | 9.26042 | 10.19572 | 11.68855 | 13.09051 | 14.84796 | 18.13730 | 22.33688 | 27.14134 | 32.00690 | 35.17246 | 38.07563 | 41.63840 | 44.18128 |

| 24 | 9.88623 | 10.85636 | 12.40115 | 13.84843 | 15.65868 | 19.03725 | 23.33673 | 28.24115 | 33.19624 | 36.41503 | 39.36408 | 42.97982 | 45.55851 |

| 25 | 10.51965 | 11.52398 | 13.11972 | 14.61141 | 16.47341 | 19.93934 | 24.33659 | 29.33885 | 34.38159 | 37.65248 | 40.64647 | 44.31410 | 46.92789 |

| 26 | 11.16024 | 12.19815 | 13.84390 | 15.37916 | 17.29188 | 20.84343 | 25.33646 | 30.43457 | 35.56317 | 38.88514 | 41.92317 | 45.64168 | 48.28988 |

| 27 | 11.80759 | 12.87850 | 14.57338 | 16.15140 | 18.11390 | 21.74940 | 26.33634 | 31.52841 | 36.74122 | 40.11327 | 43.19451 | 46.96294 | 49.64492 |

| 28 | 12.46134 | 13.56471 | 15.30786 | 16.92788 | 18.93924 | 22.65716 | 27.33623 | 32.62049 | 37.91592 | 41.33714 | 44.46079 | 48.27824 | 50.99338 |

| 29 | 13.12115 | 14.25645 | 16.04707 | 17.70837 | 19.76774 | 23.56659 | 28.33613 | 33.71091 | 39.08747 | 42.55697 | 45.72229 | 49.58788 | 52.33562 |

| 30 | 13.78672 | 14.95346 | 16.79077 | 18.49266 | 20.59923 | 24.47761 | 29.33603 | 34.79974 | 40.25602 | 43.77297 | 46.97924 | 50.89218 | 53.67196 |

| Число степеней свободы k | Уровень значимости a | |||||

| 0,01 | 0,025 | 0.05 | 0,95 | 0,975 | 0.99 | |

| 1 | 6.6 | 5.0 | 3.8 | 0.0039 | 0.00098 | 0.00016 |

| 2 | 9.2 | 7.4 | 6.0 | 0.103 | 0.051 | 0.020 |

| 3 | 11.3 | 9.4 | 7.8 | 0.352 | 0.216 | 0.115 |

| 4 | 13.3 | 11.1 | 9.5 | 0.711 | 0.484 | 0.297 |

| 5 | 15.1 | 12.8 | 11.1 | 1.15 | 0.831 | 0.554 |

| 6 | 16.8 | 14.4 | 12.6 | 1.64 | 1.24 | 0.872 |

| 7 | 18.5 | 16.0 | 14.1 | 2.17 | 1.69 | 1.24 |

| 8 | 20.1 | 17.5 | 15.5 | 2.73 | 2.18 | 1.65 |

| 9 | 21.7 | 19.0 | 16.9 | 3.33 | 2.70 | 2.09 |

| 10 | 23.2 | 20.5 | 18.3 | 3.94 | 3.25 | 2.56 |

| 11 | 24.7 | 21.9 | 19.7 | 4.57 | 3.82 | 3.05 |

| 12 | 26.2 | 23.3 | 21 .0 | 5.23 | 4.40 | 3.57 |

| 13 | 27.7 | 24.7 | 22.4 | 5.89 | 5.01 | 4.11 |

| 14 | 29.1 | 26.1 | 23.7 | 6.57 | 5.63 | 4.66 |

| 15 | 30.6 | 27.5 | 25.0 | 7.26 | 6.26 | 5.23 |

| 16 | 32.0 | 28.8 | 26.3 | 7.96 | 6.91 | 5.81 |

| 17 | 33.4 | 30.2 | 27.6 | 8.67 | 7.56 | 6.41 |

| 18 | 34.8 | 31.5 | 28.9 | 9.39 | 8.23 | 7.01 |

| 19 | 36.2 | 32.9 | 30.1 | 10.1 | 8.91 | 7.63 |

| 20 | 37.6 | 34.2 | 31.4 | 10.9 | 9.59 | 8.26 |

| 21 | 38.9 | 35.5 | 32.7 | 11.6 | 10.3 | 8.90 |

| 22 | 40.3 | 36.8 | 33.9 | 12.3 | 11.0 | 9.54 |

| 23 | 41.6 | 38.1 | 35.2 | 13.1 | 11.7 | 10.2 |

| 24 | 43.0 | 39.4 | 36.4 | 13.8 | 12.4 | 10.9 |

| 25 | 44.3 | 40.6 | 37.7 | 14.6 | 13.1 | 11.5 |

| 26 | 45.6 | 41.9 | 38.9 | 15.4 | 13.8 | 12.2 |

| 27 | 47.0 | 43.2 | 40.1 | 16.2 | 14.6 | 12.9 |

| 28 | 48.3 | 44.5 | 41.3 | 16.9 | 15.3 | 13.6 |

| 29 | 49.6 | 45.7 | 42.6 | 17.7 | 16.0 | 14.3 |

| 30 | 50.9 | 47.0 | 43.8 | 18.5 | 16.8 | 15.0 |